Agents

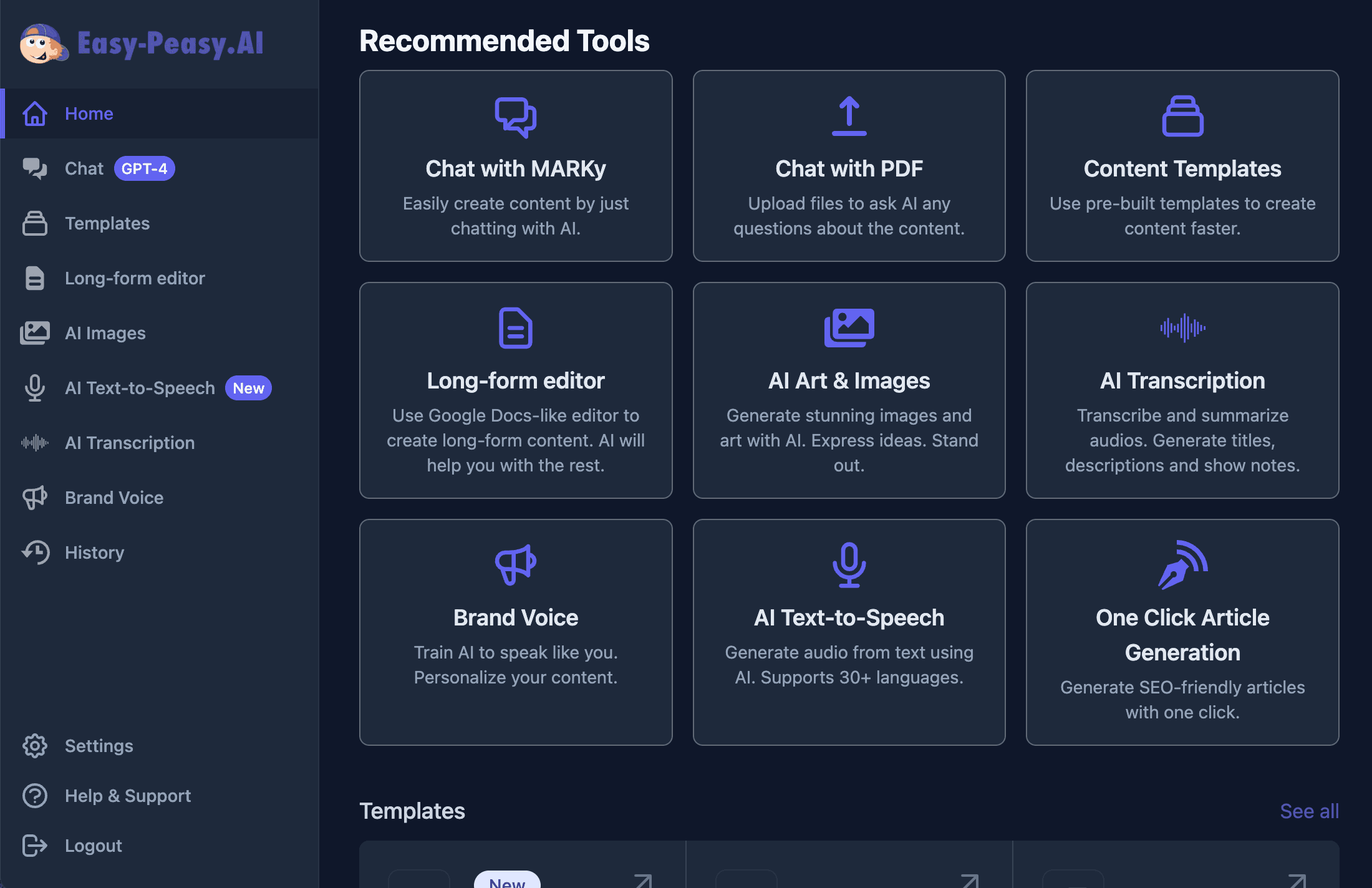

MARKy AgentBotsWorkflowsModelli di contenutoBrand VoiceImages

Generatore di immagini AIStudio fotograficoPrimi pianiGeneratore di design d'interni AIUpscaler di immagini AI gratuitoCreatore di design per T-ShirtCreatore di loghiVideo

AI Video GeneratorTalking VideosMake Image TalkMotion ControlVideo EditorAI Animate ImageAudio

AI Text-to-SpeechTrascrizione AIGeneratore di musica AIAI Sound EffectsRisorse

BlogGuidaPrezziNovitàProgramma di affiliazioneWorkshop AISeedance2.0

Quattro modalità di input. Sincronizzazione audio-video nativa. Riproduzione cinematografica. Narrazione multi-scena con estrema coerenza dei personaggi — il tutto fino a risoluzione 2K.

3,482,705+ happy users

Guarda Seedance 2.0 in azione

Output reali generati da Seedance 2.0 — dalle riprese di inseguimento in un'unica ripresa cinematografica alle narrazioni sincronizzate con l'audio e scene con più personaggi.

Ripresa di inseguimento in un'unica ripresa

Camera continua che segue i soggetti attraverso più location urbane

Cinematografico con audio nativo

Cinematografia al tramonto con auto d'epoca, foley e suoni ambientali

Compositing di scene d'azione

Scena di combattimento sotto un cielo stellato con effetti di polvere e camera dinamica

Narrativa emozionale

Storia generata da riferimenti di immagini e audio con espressioni dei personaggi

Sostituzione del personaggio

Esibizione di una band con sostituzione fluida del personaggio mantenendo il movimento

Estensione multi-scena

Scena estesa su più riprese con personaggi coerenti

Quattro modi per creare

Seedance 2.0 accetta testo, immagini, riferimenti video e audio come input — singolarmente o combinati per il massimo controllo creativo.

Da testo a video

Descrivi qualsiasi scena in linguaggio naturale e Seedance 2.0 la porta in vita con dialoghi sincronizzati, foley e audio ambientale — tutto generato nativamente.

- Controllo dettagliato di scene e azioni tramite prompt

- Generazione audio nativa (dialoghi + SFX + ambiente)

- Tutti e 6 i rapporti d'aspetto supportati

- Durata dell'output da 4 a 12 secondi

Da immagine a video

Carica un'immagine statica e guardala animarsi con movimenti realistici preservando ogni dettaglio — tratti del viso, abbigliamento, sfondo e illuminazione.

- Animazione con preservazione dell'identità

- Usa fino a 9 immagini di riferimento per personaggi e scene

- Generazione automatica dei movimenti di camera

- Stile coerente tra i fotogrammi

Riferimento video

Carica video di riferimento per estrarre movimenti di camera, movimenti dei personaggi e tempistiche. Seedance 2.0 riproduce in modo intelligente le tecniche cinematografiche senza prompt complessi.

- Estrazione e riproduzione della traiettoria della camera

- Trasferimento delle espressioni facciali dal filmato di riferimento

- Duplicazione del movimento con nuovi personaggi/scene

- Fino a 3 video di riferimento (15s totali)

Video guidato dall'audio

Usa voci fuori campo, colonne sonore o narrazioni come segnale di controllo principale. Il modello genera immagini che corrispondono al ritmo, all'emozione e alla tempistica del tuo audio.

- Generazione visiva sincronizzata al ritmo

- Lip-sync dalla voce fuori campo caricata

- Transizioni di scena guidate dalla musica

- Fino a 3 file audio (15s totali)

Fino a 12 file. Una generazione.

In precedenza, ottenere movimenti di camera complessi o video multi-scena con personaggi coerenti richiedeva la scrittura di prompt elaborati. Con Seedance 2.0, carichi semplicemente i file di riferimento e il modello estrae intelligentemente ciò di cui ha bisogno.

Tecniche di ripresa di Hollywood

Descrivi i movimenti di camera nel tuo prompt o carica un video di riferimento — Seedance 2.0 estrae e riproduce automaticamente le tecniche cinematografiche professionali.

Hitchcock Zoom

Il classico effetto dolly-zoom che crea un disorientante cambio di prospettiva — perfetto per rivelazioni drammatiche e momenti di panico del protagonista.

Riprese di inseguimento

Segui i soggetti attraverso gli ambienti con inseguimento posteriore, laterale e frontale fluido. Varianti ad angolazione bassa e alta supportate.

Circling / Orbita

Orbita multi-angolo intorno ai soggetti con accelerazione e decelerazione naturali. Crea rivelazioni dinamiche a 180° e 360°.

Crane & Boom

Movimenti verticali della camera che salgono dal livello del suolo o scendono da prospettive aeree con movimenti fluidi.

Pan & Tilt

Panoramica precisa basata sui gradi (90°, 180°) con controllo di arresto e ripresa. Segui la direzione dello sguardo del soggetto in modo naturale.

Push / Pull Zoom

Zoom fluido verso i primi piani o allontanamento per rivelare scene più ampie. Controlla il ritmo dello zoom per effetti drammatici o sottili.

Sincronizzazione audio-video nativa

A differenza di altri modelli che aggiungono l'audio come fase di post-elaborazione, Seedance 2.0 genera audio ad alta fedeltà come parte della pipeline di generazione principale. Tre livelli audio intelligenti sono sincronizzati con il contenuto visivo a livello di fotogramma.

- Dialogo — Lip-sync a livello di fonema in oltre 8 lingue

- Foley — Effetti sonori abbinati alle azioni (passi, impatti, porte)

- Ambiente — Audio ambientale (vento, folla, pioggia, traffico)

- Beat matching — Sincronizzazione del ritmo audio-video per la musica

Parlato con lip-sync · Oltre 8 lingue · Precisione a livello di fonema

Passi · Impatti · Interazioni con oggetti · SFX ambientali

Atmosfera di sottofondo · Meteo · Folla · Audio spaziale

Come funziona

Scegli i tuoi input

Inizia con un prompt testuale, carica immagini di riferimento per personaggi e scene, aggiungi video di riferimento per i movimenti di camera o fornisci audio per il lip-sync e il beat matching.

Configura l'output

Select your aspect ratio (16:9, 9:16, 1:1, etc.), video duration (4–12 seconds), and desired visual style — from photorealistic to anime to film noir.

Riferimenti con @Tags

Nel tuo prompt, usa la notazione @Image1, @Image2, @Video1 per indicare al modello esattamente come ogni file di riferimento deve influenzare l'output.

Genera e perfeziona

Seedance 2.0 elabora i tuoi input multimodali e genera video con audio sincronizzato. Perfeziona il tuo prompt o sostituisci i riferimenti per iterare.

Consigli per risultati migliori

Ottieni il massimo da Seedance 2.0 con queste tecniche di prompting dagli utenti esperti e dalla documentazione ufficiale.

Usa il linguaggio cinematografico

Include specific cinematography terms: "Hitchcock zoom", "tracking shot following the subject", "slow 180° pan", "low-angle crane rising". Seedance 2.0 understands professional film vocabulary.

“Un uomo in abito scuro cammina attraverso un corridoio illuminato al neon. La camera inizia con un'inquadratura di inseguimento posteriore, poi passa a un'orbita circolare quando raggiunge l'ascensore.”

Fai riferimento ai tuoi caricamenti

Usa la notazione @Image e @Video nei prompt per associare file specifici a ruoli. Assegna immagini a personaggi, location o riferimenti di stile, e video a riferimenti di camera o movimento.

“@Image1 è il personaggio principale. @Image2 è la location dell'ufficio. @Video1 fornisce il movimento della camera. Il personaggio si siede alla scrivania, prende il telefono e guarda fuori dalla finestra.”

Descrivi emozioni e movimento

Vai oltre le descrizioni visive. Includi stati emotivi, pattern di respirazione, micro-espressioni e linguaggio del corpo per un'animazione dei personaggi più realistica.

“La donna alza lo sguardo dal libro, gli occhi si spalancano per la sorpresa. Si alza lentamente, le mani tremano leggermente, e fa un passo esitante in avanti.”

Gestisci i livelli audio

Describe the soundscape you want: dialogue content, ambient sounds, and action-specific foley. The model generates all three audio layers natively.

“Una scena in un caffè affollato. Chiacchiericcio di sottofondo e tintinnio di tazze. Un barista annuncia un ordine. La pioggia picchietta contro la finestra. Il protagonista sospira e mescola il caffè.”

Qualsiasi estetica tu possa immaginare

Specifica lo stile visivo nel tuo prompt o lascia che il modello lo deduca dalle immagini di riferimento.

Dettagli tecnici

2.0 vs 1.5 Pro

Ogni aspetto migliorato — risoluzione, audio, input, velocità e controllo creativo.

| Funzionalità | Seedance 2.0 | Seedance 1.5 Pro |

|---|---|---|

| Risoluzione | Fino a 2K | 1080p |

| Audio nativo | Dialogo + Foley + Ambiente | Sincronizzazione audio base |

| Lip-Sync | Oltre 8 lingue, livello fonema | Supporto linguistico limitato |

| Modalità di input | Testo + Immagine + Video + Audio | Solo testo + immagine |

| File di input massimi | 12 file simultaneamente | 1–2 file |

| Coerenza dei personaggi | Estrema — continuità IP multi-scena | Buona — scena singola |

| Narrazione multi-scena | Sì — transizioni di scena automatiche | Non supportato |

| Controllo della camera | Estrazione da video di riferimento | Solo tramite prompt |

| Editing video | Editing in linguaggio naturale | Non supportato |

| Velocità di generazione | 30% più veloce | Base |

Cosa puoi creare

Contenuti per i social media

Crea video irresistibili per TikTok, Instagram Reels e YouTube Shorts. La generazione audio nativa significa che il tuo contenuto è pronto per la pubblicazione — nessun editing audio necessario.

Marketing di prodotto

Genera presentazioni cinematografiche di prodotto con movimenti di camera professionali. Carica una foto del prodotto, aggiungi un video di riferimento per la tecnica di ripresa e ottieni uno spot raffinato.

Cortometraggi e narrazioni

Produci sequenze narrative multi-scena con personaggi coerenti tra le scene. Le transizioni automatiche e la persistenza dell'identità dei personaggi consentono la creazione di contenuti episodici.

Contenuti educativi

Crea video esplicativi coinvolgenti con lip-sync della voce fuori campo sincronizzato in oltre 8 lingue. Carica l'audio della narrazione e lascia che il modello generi immagini corrispondenti.

Video musicali

Genera immagini sincronizzate al ritmo dall'input audio. Il modello sincronizza le transizioni di scena, il movimento dei personaggi e i tagli di camera al ritmo della tua musica.

Storytelling del brand

Costruisci serie di contenuti episodici con estrema coerenza dei personaggi. La mascotte del tuo brand, il portavoce o il prodotto mantiene l'identità in ogni ripresa.

Pre-visualizzazione cinematografica

Usa video di riferimento per prototipare movimenti di camera complessi prima della produzione effettiva. Testa virtualmente Hitchcock zoom, riprese con gru e sequenze in orbita.

Contenuti multilingue

Genera lo stesso video con lip-sync in inglese, mandarino, coreano, giapponese, spagnolo, indonesiano e altro — da un singolo prompt con audio diversi.

Domande frequenti

Tutto quello che devi sapere su Seedance 2.0

Cos'è Seedance 2.0?

Seedance 2.0 is ByteDance's next-generation AI video model. It generates video with native audio (dialogue, foley, and ambience) from four input types: text, images, video references, and audio. It outputs up to 2K resolution with extreme character consistency and professional camera techniques.

Cosa rende Seedance 2.0 diverso dagli altri modelli video AI?

Three key differentiators: (1) Native audio-visual generation — audio isn't post-processed but generated jointly with video, enabling true lip-sync and beat matching. (2) Reference video input — upload existing videos to extract and reproduce camera movements and character motion without complex prompting. (3) Multi-shot storytelling with extreme character consistency across scenes.

Come funziona il sistema di input multimodale?

You can combine up to 12 files: up to 9 images (for characters, locations, style references), up to 3 video clips (for camera movements and motion references, 15s total), and up to 3 audio files (for voiceover and music, 15s total). Use @Image1, @Video1 notation in your prompt to assign roles to each file.

Quali tecniche di ripresa supporta Seedance 2.0?

Seedance 2.0 understands professional cinematography language including: Hitchcock zoom (dolly-zoom), tracking shots (rear, side, frontal), orbiting/circling shots, crane and boom movements, pan and tilt with precise degree control, push/pull zoom, and robotic arm multi-angle effects. You can describe these in text or upload a reference video.

Quali risoluzioni e formati sono supportati?

Output: up to 2K resolution (1080p standard), 4–12 second duration, 6 aspect ratios (16:9, 9:16, 4:3, 3:4, 21:9, 1:1). The model supports photorealistic, anime, 2D/3D animation, watercolor, film noir, and abstract visual styles.

Come funziona la generazione audio nativa?

Seedance 2.0 generates three audio layers simultaneously with the video: Dialogue (with phoneme-level lip-sync in 8+ languages), Foley (action-matched sound effects like footsteps, impacts, and environmental interactions), and Ambience (background audio like wind, crowds, rain). All layers are synchronized with the visual content.

Posso controllare l'aspetto dei personaggi su più riprese?

Sì. Seedance 2.0 offre un'estrema coerenza dei personaggi — tratti del viso, dettagli dell'abbigliamento, accessori e stile visivo vengono mantenuti uniformemente nelle narrazioni multi-scena. Carica immagini di riferimento dei personaggi e il modello mantiene la persistenza dell'identità per tutta la sequenza generata.

Come funziona l'input da video di riferimento?

Carica fino a 3 video di riferimento (15s totali). Il modello estrae traiettorie della camera, pattern di movimento dei personaggi ed espressioni facciali dal filmato di riferimento, quindi li applica al tuo video generato con nuovi personaggi e scene. Questo sostituisce la complessa direzione della camera basata su testo.

Quali lingue sono supportate per il lip-sync?

Seedance 2.0 supports phoneme-level lip-sync in 8+ languages: English, Mandarin Chinese, Cantonese, Korean, Japanese, Spanish, Indonesian, and more. You can generate the same scene with lip-sync in different languages by changing the audio input.

Quanti crediti costa Seedance 2.0?

Seedance 2.0 utilizza un prezzo al secondo. I costi in crediti variano in base alla durata — le clip più brevi costano meno, quelle più lunghe costano di più. Visita la pagina di generazione video per le tariffe attuali dei crediti.

Posso usare i video di Seedance 2.0 a scopo commerciale?

Sì. I video generati con Seedance 2.0 su Easy-Peasy.AI possono essere utilizzati per scopi commerciali inclusi marketing, pubblicità, social media, video di prodotto e creazione di contenuti, soggetti ai nostri termini di servizio.

Quanto è veloce Seedance 2.0 rispetto alle versioni precedenti?

Seedance 2.0 è il 30% più veloce di Seedance 1.5 Pro offrendo al contempo una risoluzione superiore (fino a 2K contro 1080p), più modalità di input e generazione audio nativa multi-livello. La generazione tipica si completa in meno di 60 secondi per le clip standard.

Crea più velocemente con l'IA.

Provalo senza rischi.

Smetti di perdere tempo e inizia subito a creare contenuti di alta qualità con il potere dell'IA generativa.